- ZAM は、各コンパクト モジュール内で 9 つの機能メモリ層を垂直にスタックします

- 各 ZAM メモリ層には、正確に 1.125 GB の DRAM 容量が含まれています

- ZAM 帯域幅の推定値は現在、Nvidia HBM4 のパフォーマンス領域に近づいています

コンピューター メモリのアーキテクチャは、今後数年間で大きな構造変化を迎えることになります。

ゼロアングル メモリ (ZAM) と呼ばれる新しい設計では、チップを平面上に広げるのではなく垂直に積み重ねます。これにより、消費電力を削減しながらデータ転送速度を向上させることができます。

Intel は、既存の HBM メモリに代わる可能性のあるこのテクノロジーに重点を置いています。

9 層 ZAM メモリ設計の内部

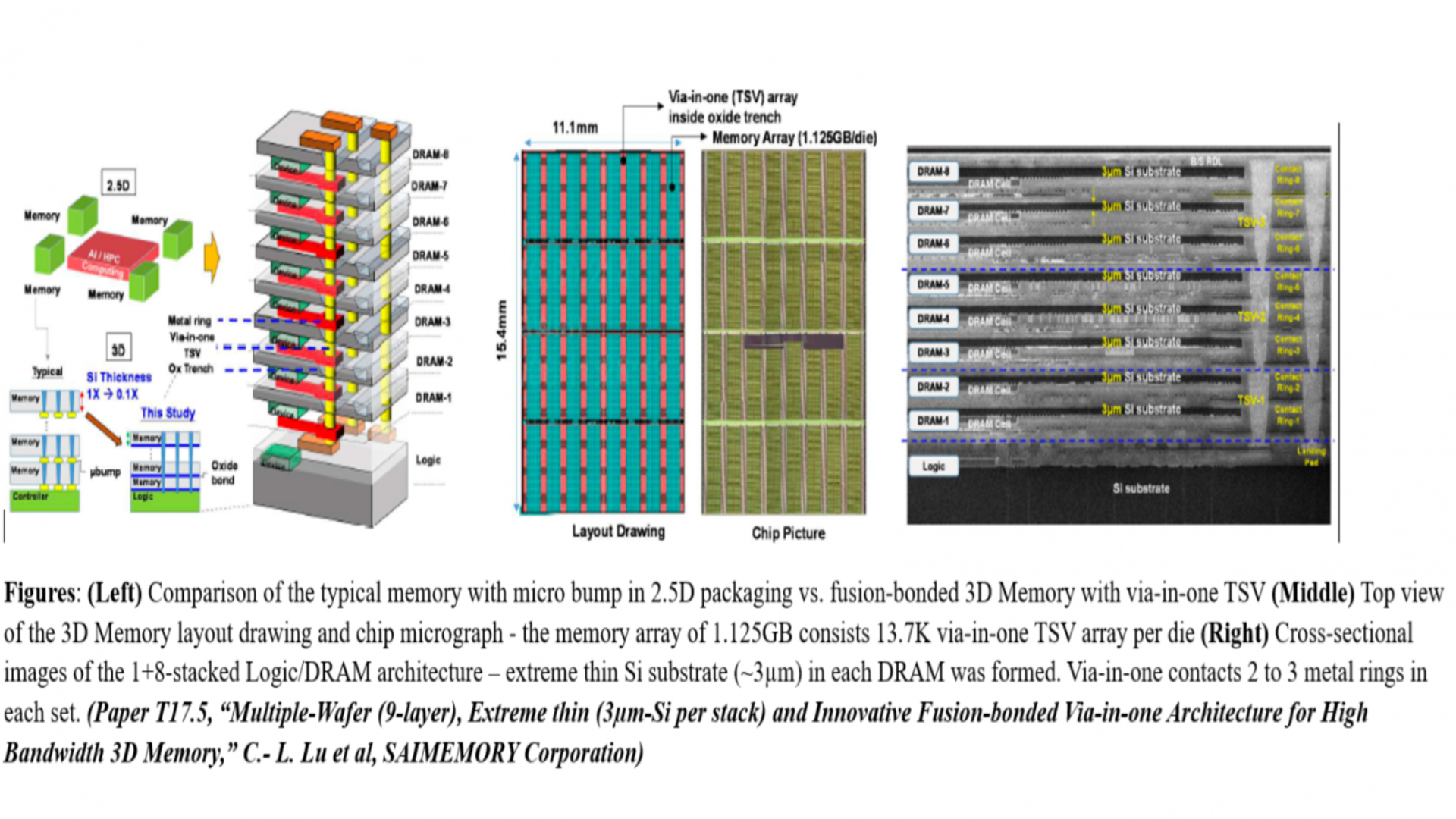

今後の VLSI カンファレンス論文の技術図により、このメモリ設計の内部詳細が明らかになりました。

8 つの個別の DRAM ストレージ層は、コンソーシアムによって構築された各 ZAM モジュール内の単一の制御層の下にあります。

この配置により、各モジュールに合計 9 つの機能層が垂直に積み重ねられるようになります。

会議資料の画像は、8 層の DRAM のそれぞれに正確に 1.125GB の記憶容量がどのように含まれているかを示しています。

したがって、基本的な計算では、一般的な控除を差し引く前に、ZAM モジュールあたりの合計メモリは約 9 GB となります。

3 つのシリコン貫通ビア (TSV) が垂直スタック全体を横断し、すべての層を上から下まで電気的に接続します。

インテルは、これらの TSV 接続を極めて高い精度と信頼性で作成する融着方式を開発しました。

各 DRAM 層は、厚さわずか 3 ミクロンのシリコン基板によって隣の層から分離されています。

これらの TSV は、安定した電気の流れを実現するために、各層の 2 つまたは 3 つの金属リングに取り付けられています。

以前の主張から導き出された帯域幅の推定値では、ZAM は Nvidia の Vera Rubin プラットフォームの HBM4 パフォーマンス数値に近くなりました。

ZAM は HBM4 クラスの帯域幅をターゲットとします

Saimemory Corporation と呼ばれる日本の企業が、インテルが支援するこのテクノロジーの商用化の取り組みを主導しています。

Saimemory は、SoftBank の完全子会社として運営されており、この新しいメモリ設計の正式なデータ速度はまだ発表していません。

同社のこれまでの声明では、現在のHBM3メモリ規格と比較して2~3倍の高速化が示唆されていた。

HBM3 は現在、標準構成で 819 GBps (または 6.4 Gbps) の帯域幅を提供しているため、そのベースラインから 3 倍に増加すると、ZAM の AI プロセッサーの合計スループットは約 2.5 TBps になります。

Nvidia の Vera Rubin AI プラットフォームは、利用可能な最大の帯域幅構成を HBM4 に依存しています。

このパフォーマンスの同等性により、Intel の HBM キラー メモリ テクノロジは、Nvidia が推奨するメモリ標準と直接競合します。

現時点では、ZAM の実用的なプロトタイプはまだ世界中のどこでも独立した審査員や第三者の試験機関に公開されていません。

欠陥を導入することなく 8 つの接着層を製造することは、このコンソーシアムにとって依然として困難で実証されていない産業上の課題です。

HBM4 はすでに、Nvidia の確立された生産ロードマップと複数のサプライヤーによる既存のグローバル サプライ チェーンの恩恵を受けています。

より高度な技術仕様を備えたメモリ標準は、広範なエコシステムの導入と長期にわたる業界のサポートがなければ失敗することがよくあります。

6 月の VLSI カンファレンスのプレゼンテーションでは、Intel の HBM-Killer の主張が紙の図を超えて物理的な現実にまで及ぶかどうかが決まります。

HPC ワイヤー経由

Google ニュースで TechRadar をフォローしてください e 私たちを優先情報源として追加してください 私たちのニュース、解説、専門家の意見をフィードに直接配信します。