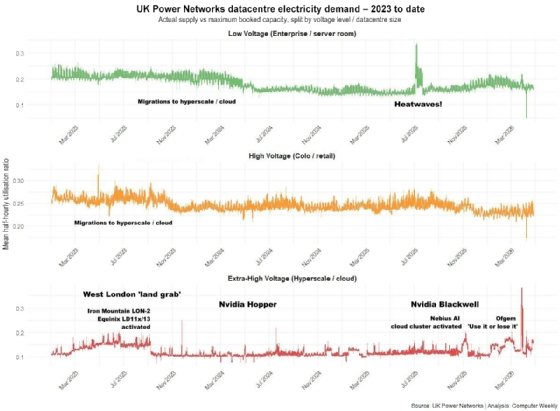

グラフィックス プロセッシング ユニット (GPU) の出荷に先立って容量を確保するための電力網の「土地収奪」。データセンターの電源がオンになると、容量が増加します。そして、Hopper GPU と Blackwell GPU の登場、実装、そして「書き込み」。

これらは、地域内の 96 のデータ センターの 30 分ごとの電力使用料金を提供する電力ネットワーク プロバイダー UK Power Networks (UKPN) のデータで確認できることの一部です。これは、西ロンドンとドックランズのデータセンターのホットスポットから南東にケント、サリー、サセックスにまで広がり、エセックスとイーストアングリアの全域が含まれます。

Computer Weekly による 2026 年 3 月の調査では、電気性能証明書のデータを分析してデータ センターの場所と容量を特定し、UKPN 地域に 80 か所のデータ センターがあり、合計容量は 798 MW であることがわかりました。

UKPN データ セットは 2023 年初めに開始され、2026 年 4 月まで実行されます。合計で約 540 万行で構成され、ネットワークからインポートされた電圧によって分類されたデータ センター (特別高圧 (12 サイト)、高圧 (60 サイト)、および低圧 (24 サイト)) のデータ センターをカバーしています。

利用率は、スマートメーターによって30分ごとに測定される実際の電力輸入量と、顧客が予約した最大容量を比較することによって計算されます。

サイト電圧は、データセンターの想定されるサイズに対応します。低電圧 (LV) サイトは通常、中小企業、エッジ データ センター、サーバー ルーム向けの 400 V 接続です。 UKPN からの高電圧 (HV) データは、おそらくコロケーション ハブおよびミッドレンジ データ センターへの 11kV または 33kV 接続を指します。高電圧 (EHV) 接続は 33kV、66kV、または 132kV で、ハイパースケール キャンパスや新興の人工知能 (AI) 工場をカバーします。

すべての UKPN データの平均使用率は、予約容量の 20% をわずかに超える程度です。超高電圧サイトでは、割り当てられた電源の使用量が最も少なく (12%)、低電圧サイトではより多く (18%) が使用されます。

データ ポイントを取得し、データ センターのサイズに対応する電圧レベルで分割します。その後、それらはグラフ上に表示され、ディップ、プラトー、ピークなどが表示されます。これらは、新しいデータセンター容量のアクティブ化、AI GPU 導入に先立つ予約容量の増加、2025 年 7 月から 8 月の熱波、AI データセンター インフラストラクチャの実際の導入と「バーンイン」、2026 年初頭の Ofgem の「使用するか失うか」指令の克服を急ぐなど、現実世界のイベントに対応しています。

グラフは使用率を示しているため、猛暑時の冷却のためのエネルギー消費量の増加など、増加の原因が明らかな場合もありますが、予約容量の増加により比率が変化するなど、他の変化はそれほど明らかではない場合もあります。

次に、データに現れる主要なイベントのいくつかを見てみましょう。

小規模サイトは熱波に対応できない: 2025 年 7 月と 8 月

緑色のデータ (低電圧サイト) で最も鋭いピークの 1 つは 2025 年の 7 月と 8 月に発生しており、気象データによると、英国では 6 月から 8 月の間に 4 回の別々の熱波が発生しました。 7月1日にはケント州の気温が35.8℃に達したが、8月は夜間の気温が高かった。

グラフ内のスパイクは、温度を下げようと必死に努力している小規模な空冷データセンターとサーバールームの電気的痕跡を示しています。液体冷却を使用する大規模なハイパースケール サイトとは異なり、小規模なサイトは気候ストレスに対して最も脆弱です。

彼らは通常、従来の直接膨張式エアコンに依存しています。周囲温度が 30°C を超えると、これらのユニットは現状を維持するためだけに通常の 2 ~ 3 倍の電力を消費します。ここで電力使用率が増加するのは、IT 負荷が静止している間に施設の総電力が急増し、電力使用効率 (PUE) が一時的に低下するためです。

生産能力の増加: 比率の減少: 2023 年後半から 2024 年まで

データによって明らかになったストーリーの多くは、GPU の提供と展開を見越して、大規模サイトが容量を追加し、より多くの電力を確保しているというものです。これは 2023 年末から 2024 年にかけて起こり始めました。

最大規模のデータセンター (赤い線) で 2023 年 9 月と 10 月に急激に減少したのは、おそらく容量の詰まりの結果です。

そのため、ハイパースケール サイトが新しいフェーズをアクティブ化すると、そのインポート容量、つまりネットワークの予備電力の合計 (分母) が即座に急増します。しかし、IT 負荷 (分子) は、サーバーが物理的に保管され、翌月に「焼き付けられる」までにいっぱいになるだけであるため、使用率は低いように見えます。

同時に、2023 年末から 2024 年にかけて、緩やかな減少 (青い線) とより急な減少 (緑の線) が見られます。これは、より大規模で新しく効率的な施設が汎用ワークロードを古い中小規模の施設から移動させていることを示している可能性があります。

CBRE の予測では、2024 年までにロンドンに大規模コロケーションが追加され、その容量は 130MW に達すると予想されており、この新しい効率的な容量がオンラインになると、効率の悪いサイトが「空」になりました。

小規模なデータセンター (おそらく企業所有または古い小売店のコロケーション サイト) の使用率が 0.2 ~ 0.15 に落ち着くまでに 2024 年 5 月までかかったという事実は、移行期間が長かったことを示しています。ワークロードを大規模なソフトウェア定義ブロックで移動するハイパースケーラーとは異なり、小規模な組織は物理ハードウェアのライフサイクルに縛られる可能性が高くなります。

2023 年末までにこの機能を有効化したサイトは次のとおりです。

- Iron Mountain の LON-2 は、Slough で最終的に 27MW の容量の第 1 段階が開始され、2023 年末に稼働することが確認されました。そのネットワーク容量は、試運転前の段階の一環として、2023 年 9 月に UKPN システムで予約される可能性があります。

- 一方、エクイニクスのLD11x/LD13拡張は、3大ハイパースケーラーを誘致するために特別に設計されており、2023年末までに建設から「利用可能な容量」に移行します。

GPU供給制限と「西ロンドンの土地強奪」

2023 年後半の時点で、Nvidia GPU クラスターのリードタイムは非常に長くなり、Omdia は H100 ベースのサーバーの場合 36 ~ 52 週間を報告しています。同時に、データセンター事業者はネットワーク プロビジョニングに奔走し、多くの場合、2024 年半ばから後半に最終的に到着する Hopper GPU の導入に備えられるように、すぐに使用できる量をはるかに超える予約を行っていました。これが、グラフ上で 2023 年後半にネットワーク使用率が急減しているように見えるもう 1 つの理由です。

2022年7月、ロンドン大庁(GLA)は開発者に警告を発し、ヒリンドン、イーリング、ハウンズローでの新たな大規模計画申請は最大10年の遅れに直面し、一部の接続日は2035年または2037年に延期される可能性があると述べた。

その限界点は、M4 回廊沿いのデータセンターの極端な集中によって引き起こされました。 2023 年半ばまでに、データセンターは西ロンドンの総需要の 18% を占めるようになりました。開発業者が将来のエネルギー容量を法的に「留保」し、新しい住宅や産業プロジェクトのための空きスペースをゼロにしていたため、送電レベルの容量と地域配電はフル容量に達した。

エクイニクスやデジタル・リアルティなどのデータセンター不動産投資信託(REIT)の財務報告書がこれを裏付けている。これらの企業は2023年の年次報告書で、キャパシティが署名されコミットされているがまだ請求されていない「バックログ」が歴史的なレベルにあると指摘した。

データでは、遅延が大きいということは、配電網事業者 (UKPN) が電力を割り当てているものの、サーバーが回転していないことを意味しており、これは、AI 以前の土地占有率と比較して使用率が低いベースラインに設定されていた 2023 年から 2024 年の期間と一致しています。

比率がすぐに回復しなかった理由は、AI 密度が以前の密度よりも効率的であるためです。 1 つの H100 ラックは 40 kW を消費しますが、それぞれ 5 kW を消費する数十の従来のラックを置き換えます。ホッパー GPU は 2024 年半ばから後半にようやく到着し、その幻の容量を埋めましたが、2023 年にはネットワーク容量がオーバーブッキングされていたため、使用率は低いままでした。業界は効果的にバッファーを構築し、現在もそれを埋め続けています。

GPU、AI データセンターのバーンインの実装: 2024 年と 2025 年

2024 年半ばのピークは、Nvidia Hopper (H100/H200) GPU の導入の可能性が高い時期と一致します。 Hopper 世代は、700W の熱設計電力 (TDP)、つまり冷却設計に必要な電力を達成した最初の GPU でした。 8 GPU の HGX H100 ノードは約 10.2 kW を消費します。 2024 年後半のデータの急増は、数千台のこれらのユニットが電力消費を同期する大規模なトレーニング実行の開始を表している可能性があります。

これらは、前世代のアンペア (A100) の定常状態の消費量から、高密度で揮発性の高いプロファイルまで、データセンターの電力ダイナミクスの変化を表しています。

2025 年後半には、Hopper から Blackwell の高密度液体冷却要件に切り替わりました。この移行は、定常状態の電力消費から不安定なプラトーおよび大規模なブラックウェル トレーニング エポックの「ピーク」への明確な移行として UKPN テレメトリに反映されています。

2025 年 11 月から始まるグラフの「山脈」は、英国初の Nvidia Blackwell (B200) クラスターがオンになった月を示しています。これはモデルの初期トレーニングの特徴であり、非常に集中的で継続的なプロセスです。

各 B200 GPU の基本 TDP は 1,000 W で、最大 1,200 W まで構成可能です。一方、2024 年後半に出荷された GB200 Grace-Blackwell スーパーチップは、その極度の密度に対応するためにチップへの直接液体冷却を必要としました。

ここで決定的なきっかけとなったのは、サリー州にあるアーク データ センターのロングクロス パークでの Nebius AI Cloud クラスターの立ち上げです。これは、数千個の Nvidia Blackwell GPU と 16 MW の署名を備えて、2025 年 11 月に稼働しました。

EHV ラインは 2026 年 3 月まで高くてでこぼこした状態が続き、これはフロンティア モデルの事前トレーニング中に「エポック」と「チェックポイント」が高く継続的に引き込まれたことを反映しています。

最後のピーク: 紛失しないように使用しますか?

2026年3月末の巨大なピークは、2026年3月13日のOfgemのデマンド接続改革期限と一致する。

特にデータセンター事業者からの電力需要の大幅な増加に直面し、需要待ち行列が2025年6月までに125GWに増加する中、Ofgemはより厳しい財務テストと、待ち行列を解消するための「使うか失うか」ルールを提案していた。駐車容量を持つ大規模事業者は、新しい規則によって未使用のメガワットの回収が認められる前に、プロジェクトが「実行可能」で「戦略的に重要」であることを証明するためにエネルギー消費量を示すよう奨励された。